Open WebUI: La Tua ChatGPT Personale nel 2025 (Completamente Offline)

Se sei qui dopo aver letto la mia guida su DeepSeek in locale oppure ti stai semplicemente chiedendo se esiste un modo più comodo, funzionale ed elegante per interagire con la tua IA locale invece di usare il terminale, la risposta è sì, e si chiama Open WebUI.

Cos’è Open WebUI

Open WebUI rappresenta l’evoluzione naturale nell’utilizzo di modelli IA locali. È un’interfaccia web moderna ed elegante che trasforma l’esperienza da terminale in qualcosa di più simile a ChatGPT o Claude, ma con un vantaggio fondamentale: tutto rimane sul tuo computer. Non dovrai più preoccuparti della privacy dei tuoi dati o di costosi abbonamenti mensili. Puoi gestire multiple conversazioni, analizzare documenti e persino generare immagini, tutto localmente e gratuitamente.

Prima di Iniziare

Per far funzionare Open WebUI al meglio, il tuo computer dovrebbe avere almeno 16GB di RAM (anche se personalmente sono riuscito a farlo girare su un MacBook Air M2 con 8GB), un processore decente e/o una GPU NVIDIA e circa 7GB di spazio libero su disco. Se hai già installato Docker e Ollama seguendo la mia guida precedente, sei già a metà dell’opera.

5 Modi per Installare Open WebUI con Docker (e uno senza)

L’installazione di Open WebUI cambia leggermente in base al tuo setup. Se hai Ollama in esecuzione sul tuo computer, usa questo comando:

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:main

Se invece Ollama è su un altro server, modifica il comando specificando l’URL corretto:

docker run -d -p 3000:8080 \

-e OLLAMA_BASE_URL=https://tuo-server.com \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:main

Per chi ha una GPU NVIDIA e vuole sfruttarne la potenza:

docker run -d -p 3000:8080 --gpus all \

--add-host=host.docker.internal:host-gateway \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:cuda

C’è anche un’immagine all-in-one che include sia Open WebUI che Ollama. Con GPU:

docker run -d -p 3000:8080 --gpus=all \

-v ollama:/root/.ollama \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:ollama

O senza GPU:

docker run -d -p 3000:8080 \

-v ollama:/root/.ollama \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:ollama

E per chi preferisce Python, c’è l’installazione via pip:

pip install open-webui

open-webui serve

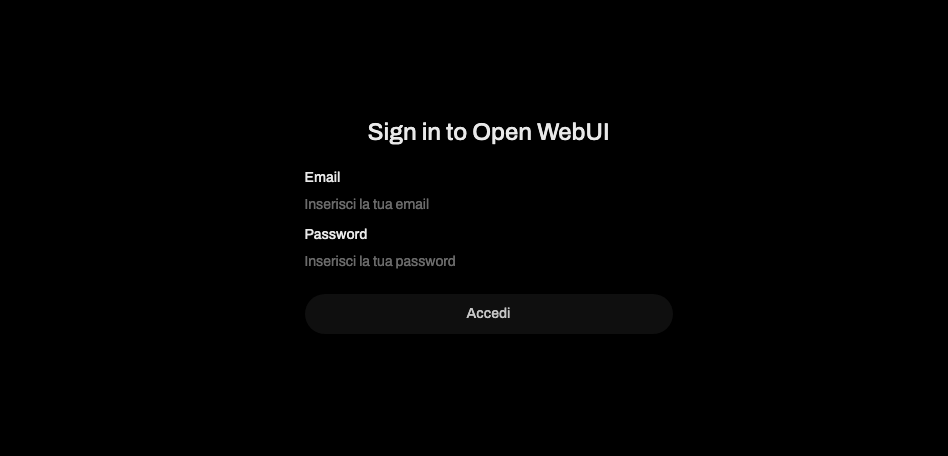

Primo Avvio e Configurazione

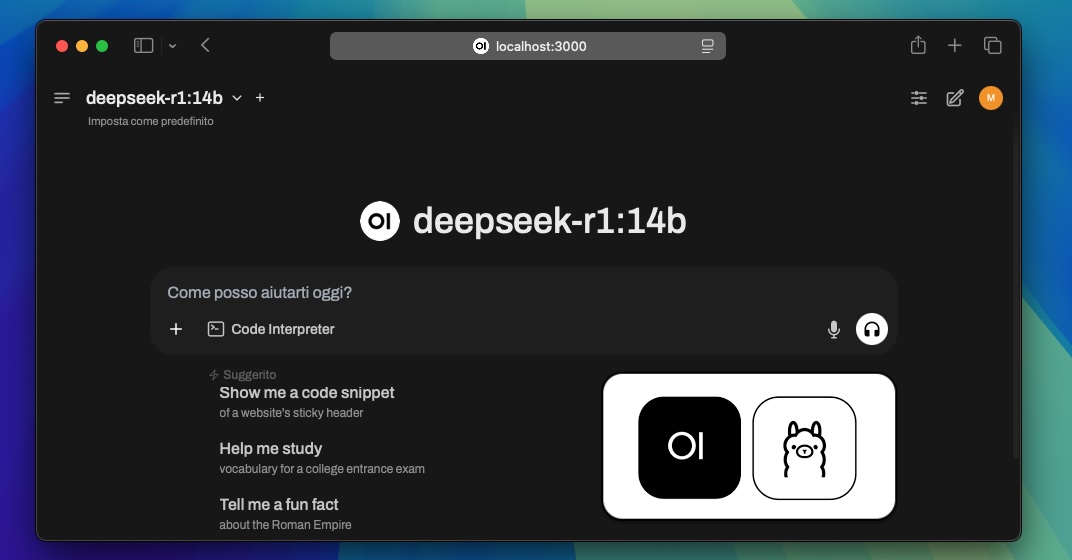

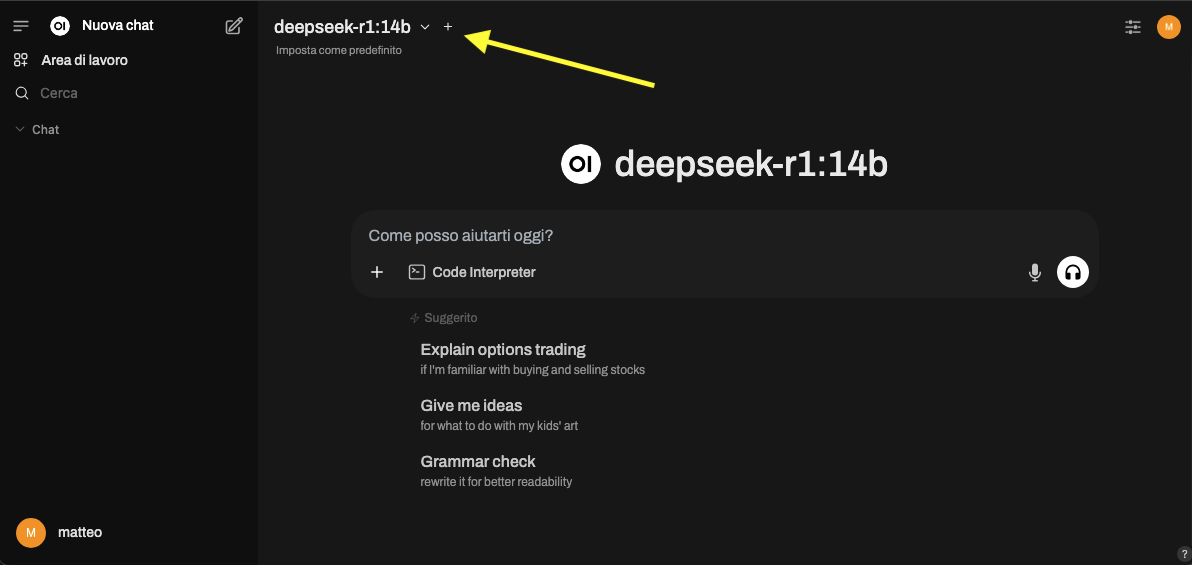

Una volta completata l’installazione, apri il tuo browser preferito e vai su http://localhost:3000 (oppure http://localhost:8000 se non utilizzi Docker). La prima cosa che dovrai fare è creare un account amministratore. Non preoccuparti, tutto rimane sul tuo computer - puoi anche usare un’email finta se vuoi. Dopo aver creato l’account ti troverai difronte a questa schermata:

Dopo il login, potrai selezionare quali modelli usare. Se hai seguito la mia guida su DeepSeek, dovresti già vedere il modello disponibile nella lista.

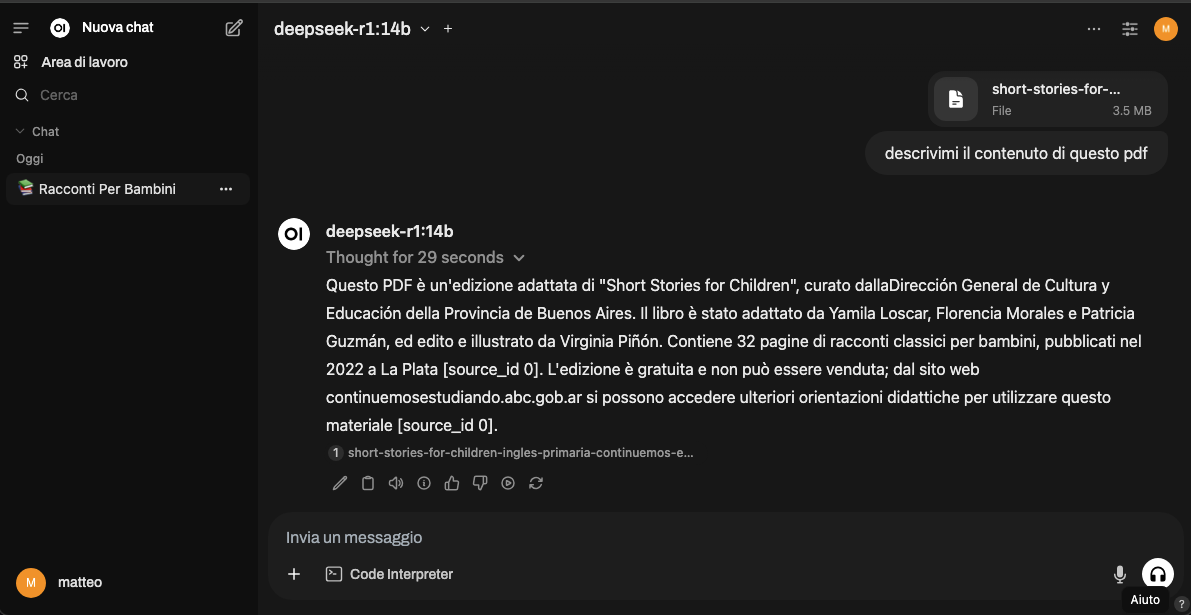

Le Funzionalità Che Ti Faranno Innamorare

Una delle cose più interessanti di Open WebUI è la sua capacità di analizzare documenti. Immagina di avere una documentazione tecnica di 100 pagine e dover trovare una risposta specifica. Invece di leggerla tutta, puoi caricarla in Open WebUI e lasciare che l’IA faccia il lavoro pesante per te.

Puoi anche creare modelli personalizzati che combinano diversi modelli base con le tue knowledge base. È come avere un assistente specializzato per ogni tipo di compito. E la cosa migliore? Puoi gestire multiple conversazioni contemporaneamente, organizzarle in cartelle e persino condividerle con i tuoi colleghi (sempre localmente, ovviamente).

Resta Aggiornato

Una volta installato, vorrai mantenere Open WebUI aggiornato. Il modo più semplice per farlo è usando Watchtower:

docker run --rm --volume /var/run/docker.sock:/var/run/docker.sock containrrr/watchtower --run-once open-webui

Questo comando verificherà e installerà automaticamente l’ultima versione disponibile di Open WebUI.

Quando Le Cose Non Vanno Come Previsto

Se dovessi incontrare problemi di connessione, la prima cosa da fare è verificare che Ollama sia in esecuzione (usa ollama list nel terminale). Se tutto sembra a posto ma Open WebUI continua a non funzionare, prova a controllare i log con docker logs open-webui.

Nel caso peggiore, puoi sempre fare un reset completo fermando il container (docker stop open-webui), eliminando la cartella dati (rm -rf ${HOME}/open-webui) e riavviando tutto. È come formattare il telefono: risolve molti problemi, ma perdi tutti i dati.

Il Futuro è Locale (E Open Source)

Open WebUI dimostra che non dobbiamo più scegliere tra funzionalità avanzate e privacy. Nel 2025, con i modelli IA che diventano sempre più efficienti e le interfacce sempre più sofisticate, soluzioni come questa non sono più solo un’alternativa interessante ma una scelta pratica e sensata.

La comunità sta continuamente sviluppando nuovi plugin e funzionalità. Abbiamo già la generazione di immagini integrata, l’analisi avanzata del codice e persino il supporto per le chat vocali. E questo è solo l’inizio.

Vale la Pena Provarlo?

Assolutamente sì. Open WebUI trasforma completamente l’esperienza di utilizzo dei modelli IA locali. Non è più una questione di smanettare col terminale (anche se quello ha il suo fascino), ma di avere uno strumento professionale e intuitivo che chiunque può usare.

Se stai ancora leggendo e non hai ancora provato a installarlo, ti suggerisco di farlo ora. Nel tempo che hai impiegato a leggere questo articolo, avresti già potuto configurarlo e iniziare a usarlo. E se incontri problemi, beh, sai dove trovarmi!

P.S. Se pensi che questo sia interessante, aspetta di vedere cosa ho in serbo per il prossimo articolo della serie. Spoiler: coinvolge l’intelligenza artificiale, un po’ di magia con Docker, e forse qualche bestemmia in aramaico antico quando le cose non funzionano come dovrebbero!

Risorse Utili: